Die Bedrohungslage im Cyberraum verändert sich derzeit mit hoher Geschwindigkeit. Während Angreifer zunehmend auf Künstliche Intelligenz (KI) setzen, um Angriffe zu automatisieren, zu tarnen und zu optimieren, basieren viele Verteidigungssysteme weiterhin auf statischen, manuell gepflegten Regeln. Zwischen strategischem Bedrohungswissen und operativer Angriffserkennung entsteht so eine wachsende Lücke. Genau hier setzt ein aktuelles Forschungsprojekt am Technologietransferzentrum Würzburg (TTZ-WUE) an.

KI als Katalysator moderner Angriffe

Die Nutzung von KI in Angriffsszenarien hat die Dynamik in den vergangenen Jahren grundlegend verändert. Angreifer identifizieren Schwachstellen automatisiert, personalisieren Phishing-Kampagnen und umgehen Erkennungssysteme durch adaptive, lernfähige Schadsoftware [1].

Studien zeigen, dass über 50 % der mit KI erstellten Phishing-Mails erfolgreich sind, und dass mehr als 80 % aller aktuellen Phishing-Kampagnen auf KI-generierte Inhalte zurückgreifen [2][3]. Malware analysiert ihre Umgebung und verändert ihr Verhalten zur Laufzeit, um Erkennungsmechanismen gezielt zu umgehen [4].

Diese Entwicklung macht klassische signaturbasierte Verfahren zunehmend wirkungslos. Statische Erkennungsregeln können mit der Geschwindigkeit und Variabilität moderner Angriffstechniken kaum noch mithalten.

Aktuelle Rolle von KI in der Verteidigung

Auch Verteidigungssysteme integrieren heute bereits maschinelles Lernen, etwa in SIEM- (Security Information and Event Management) und EDR-Lösungen (Endpoint Detection and Response). Diese Systeme erkennen Anomalien in großen Datenmengen und verkürzen Reaktionszeiten erheblich [5].

Dennoch bleiben die Modelle überwiegend reaktiv: Sie registrieren, dass ein ungewöhnliches Verhalten auftritt, ohne dessen Ursache oder Kontext zu verstehen. Zeitliche und kausale Zusammenhänge zwischen Ereignissen werden bislang selten modelliert. Die Verbindung zwischen Bedrohungswissen, Ursache und Erkennung bleibt damit schwach [6].

Forschungsansatz am TTZ-WUE

Das Technologietransferzentrum Würzburg untersucht aktuell, wie sich diese Lücke schließen lässt. Im Fokus steht die Kombination von Bedrohungswissen aus Cyber Threat Intelligence (CTI) mit dynamischen Verhaltensdaten aus Sandbox- und Analysesystemen.

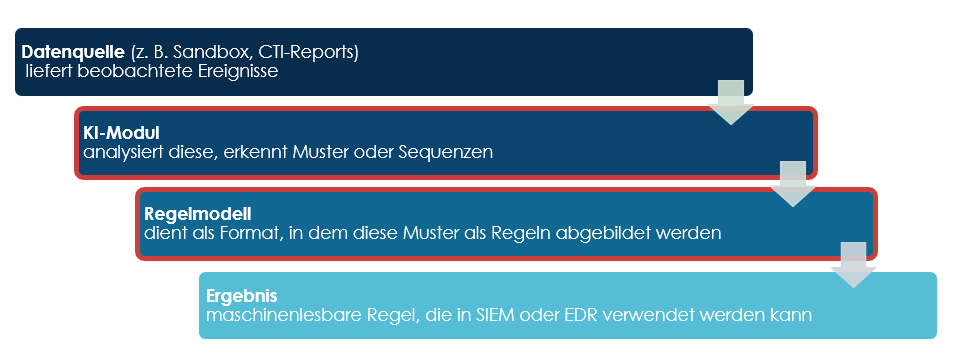

Ziel ist es, zeitliche und kausale Abhängigkeiten zwischen sicherheitsrelevanten Ereignissen automatisiert zu erkennen und daraus formale Erkennungsregeln abzuleiten. Wie in Abbildung 1 zu sehen ist, reicht der Prozess von der Datenerfassung über die Analyse durch ein KI-Modul bis hin zur automatisierten Erstellung maschinenlesbarer Regeln. Langfristig soll so ein KI-gestütztes Regelmodell entstehen, das eigenständig Detektionsregeln in Formate wie Sigma, YARA oder EQL überführt und bestehende SIEM- und EDR-Systeme adaptiv erweitert.

Abbildung 1: Ablauf der automatisierten Erzeugung von Detektionsregeln durch KI

Mehr Dynamik, Nachvollziehbarkeit und Automatisierung

Der Ansatz sorgt somit für mehr Geschwindigkeit und für Transparenz in der Verteidigung gegen digitale Bedrohungen. KI wird dabei nicht als undurchsichtige Blackbox verstanden, sondern als erklärbares Werkzeug, das nachvollziehbar zeigt, wie und warum eine Regel entstanden ist.

Damit unterstützt das Projekt ein zentrales Ziel des TTZ-WUE: die Entwicklung praxisnaher, vertrauenswürdiger und adaptiver Sicherheitslösungen, die Forschung und Anwendung gleichermaßen verbinden.

Die Zukunft der Cyberabwehr liegt in der intelligenten Verbindung von Wissen, Automatisierung und Echtzeitreaktion. KI-gestützte, dynamische Regelmodelle können Sicherheitsmechanismen flexibler, nachvollziehbarer und widerstandsfähiger machen und bilden damit eine wichtige Grundlage für die Abwehr moderner, KI-basierter Bedrohungen.

Quellen

[1] S. L. Mirtaheri, N. Movahed, R. Shahbazian, V. Pascucci, and A. Pugliese, “Cybersecurity in the age of generative AI: A systematic taxonomy of AI-powered vulnerability assessment and risk management,” Future Generation Computer Systems, vol. 175, p. 108107, 2026. doi: 10.1016/j.future.2025.108107.

[2] Arntz, Pieter: AI-supported spear phishing fools more than 50% of targets. Malwarebytes, 2025. URL: https://www.malwarebytes.com/blog/news/2025/01/ai-supported-spear-phishing-fools-more-than-50-of-targets

[3] Security Magazine: 82% of all phishing emails utilized AI. 2025. URL: https://www.securitymagazine.com/articles/101490-82-of-all-phishing-emails-utilized-ai

[4] S. Tabassum, M. Rafsan, S. Hoque, and A. Jaigirdar, “Examining Evasive Malware Techniques: A Memory-Based and Behavioral Study of AgentTesla,” Journal of Computer Science and Technology Studies, vol. 7, pp. 240–249, 2025. doi: 10.32996/jcsts.2025.7.10.28.

[5] D. S. Berman, A. L. Buczak, J. S. Chavis, and C. L. Corbett, “A survey of deep learning methods for cyber security,” Information, vol. 10, no. 4, p. 122, 2019. doi: 10.3390/info10040122.

[6] A. Lekssays, H. T. Sencar, and T. Yu, “From Text to Actionable Intelligence: Automating STIX Entity and Relationship Extraction,” arXiv preprint arXiv:2507.16576v1, Jul. 22 2025. doi:10.48550/arXiv.2507.16576.